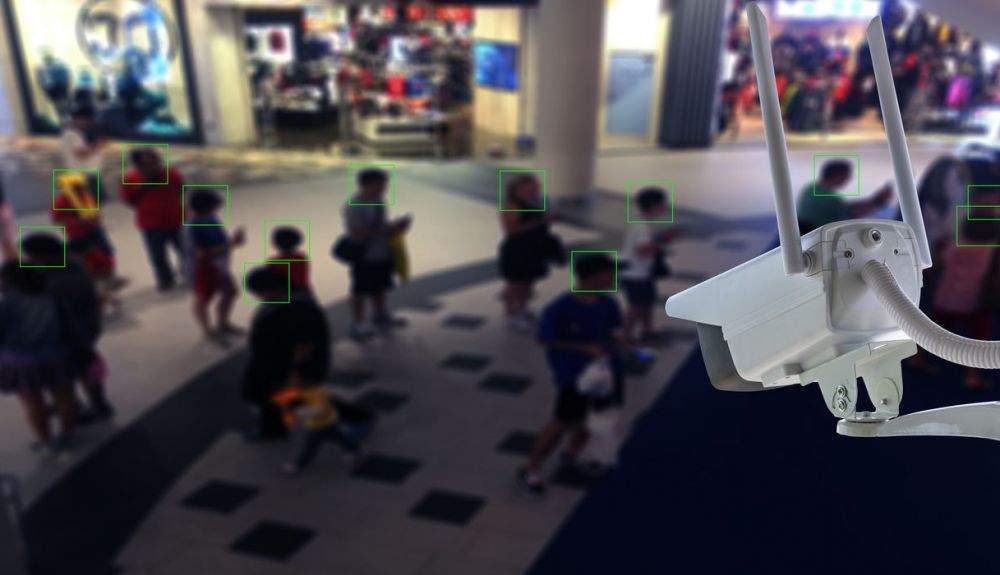

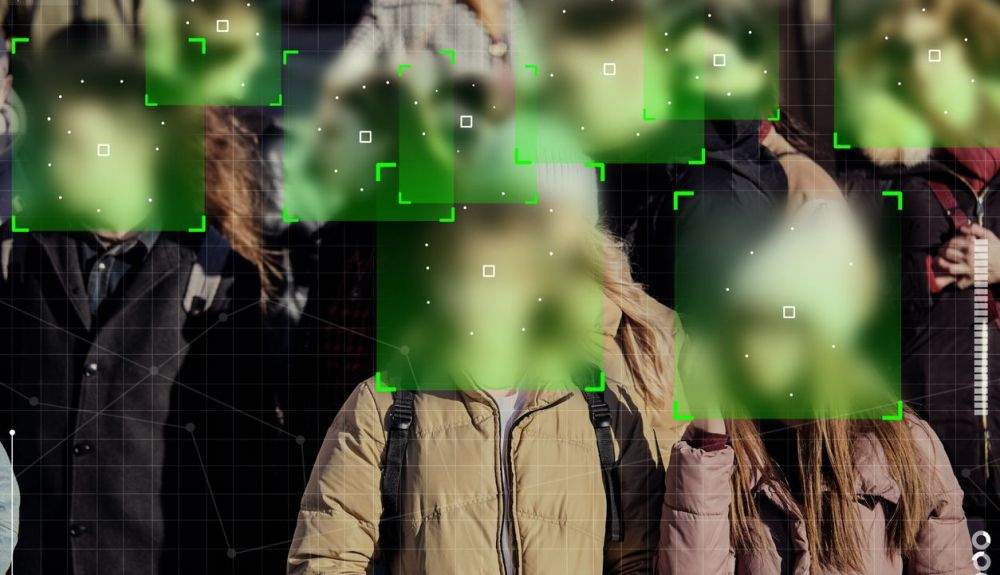

En Liverpool, Inglaterra, en una conferencia de febrero de 2020 sobre el tema poco glamoroso de las compras gubernamentales, los asistentes circulaban a través de exhibiciones de expositores y proveedores, deteniéndose en algunos, evitando otros. Estaban siendo vigilados de cerca.

Alrededor de la sala, 24 cámaras discretamente colocadas rastreaban los movimientos de cada persona y catalogaban contracciones sutiles en los músculos faciales de los individuos a medida que reaccionaban a diferentes pantallas. Las imágenes se enviaron a una red informática, donde los algoritmos de inteligencia artificial evaluaron el género y el grupo de edad de cada persona y analizaron sus expresiones en busca de signos de "felicidad" y "compromiso".

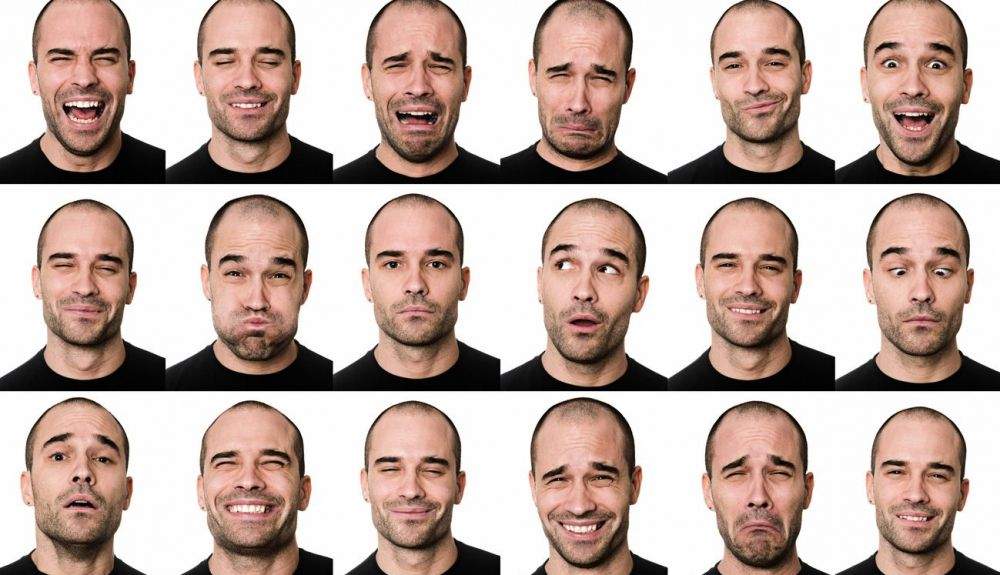

Los ingenieros de Zenus habían entrenado al sistema para reconocer emociones, al hacer que examinara un enorme conjunto de datos de expresiones faciales con etiquetas que describían sentimientos relevantes

Aproximadamente un año después del evento de Liverpool, Panos Moutafis, CEO de Zenus, con sede en Austin, Texas, la compañía detrás de la tecnología, se mostraba entusiasmado con los resultados. "No he visto muchos sistemas comerciales que obtengan este nivel de precisión", aseguró durante una videollamada, mostrando una fotografía de la multitud.

Los ingenieros de Zenus habían entrenado al sistema para reconocer emociones, al hacer que examinara un enorme conjunto de datos de expresiones faciales con etiquetas que describían sentimientos relevantes. La compañía validó el rendimiento del programa de varias maneras, incluidas las pruebas en vivo cuando las personas informaron cómo se sentían cuando se tomó una imagen. El sistema, aseguró Moutafis, "funciona en interiores, funciona con máscaras, sin iluminación, y funciona al aire libre cuando las personas usan sombreros y gafas de sol".

La configuración de Zenus es un ejemplo de una nueva tecnología, llamada IA emocional o computación afectiva, que combina cámaras y otros dispositivos con programas de inteligencia artificial para capturar expresiones faciales, lenguaje corporal, entonación vocal y otras señales.

El objetivo es ir más allá del reconocimiento facial y la identificación para revelar algo previamente invisible a la tecnología: los sentimientos internos, las motivaciones y las actitudes de las personas en las imágenes.

"Las cámaras han sido tontas", afirma jay Stanley, analista senior de políticas de A.C.L.U., autor del informe de 2019 The Dawn of Robot Surveillance. "Ahora se están volviendo inteligentes. Están despertando. Están ganando la capacidad no solo de registrar tontamente lo que hacemos, sino de hacer juicios al respecto".

Emotion IA, una herramienta de investigación de mercado

Emotion AI se ha convertido en una herramienta popular de investigación de mercado: en otra feria comercial, Zenus comunicó a Hilton Hotels que un evento que la compañía organizó fue más atractivo que la barra libre del evento, pero su alcance se extiende a áreas donde las apuestas son mucho más altas.

Los sistemas que leen señales de sentimiento, carácter e intención se están utilizando o probando para detectar amenazas en los puntos de control fronterizos, evaluar a los candidatos a un trabajo, monitorear las aulas para detectar aburrimiento o interrupción y reconocer signos de conducción agresiva.

Algunas aplicaciones utilizan los datos que recopilan para sondear no las emociones, sino las ideas relacionadas, como qué tipo de personalidad tiene una persona y si está prestando atención o representa una amenaza potencial

Los principales fabricantes de automóviles están poniendo la tecnología en las próximas generaciones de vehículos, y Amazon, Microsoft, Google y otras compañías tecnológicas ofrecen servicios de inteligencia artificial de emociones basados en la nube, a menudo incluidos con reconocimiento facial. Docenas de nuevas empresas están implementando aplicaciones para tomar decisiones de contratación. La práctica se ha vuelto tan común en Corea del Sur, por ejemplo, que a menudo se usa para pasar entrevistas de trabajo que usan IA.

Los sistemas de IA utilizan varios tipos de datos para generar información sobre la emoción y el comportamiento. Además de las expresiones faciales, la entonación vocal, el lenguaje corporal y la marcha, pueden analizar el contenido del habla o la escritura para detectar afecto y actitud. Algunas aplicaciones utilizan los datos que recopilan para sondear no las emociones, sino las ideas relacionadas, como qué tipo de personalidad tiene una persona y si está prestando atención o representa una amenaza potencial.

Críticos con el alcance de la IA emocional

Pero los críticos advierten que el alcance de la IA emocional se excede de maneras potencialmente peligrosas. Los algoritmos se pueden entrenar en conjuntos de datos con sesgos raciales, étnicos y de género incrustados, lo que a su vez puede perjudicar sus evaluaciones, por ejemplo, contra los solicitantes de empleo no blancos. "Existe la idea de que podemos descargar algunos de nuestros procesos cognitivos en estos sistemas", explica Lauren Rhue, científica de sistemas de información de la Universidad de Maryland, que ha estudiado el sesgo racial en la IA emocional.

Muchos investigadores dicen que los algoritmos no pueden, todavía, leer consistentemente las sutilezas de las expresiones humanas en diferentes individuos

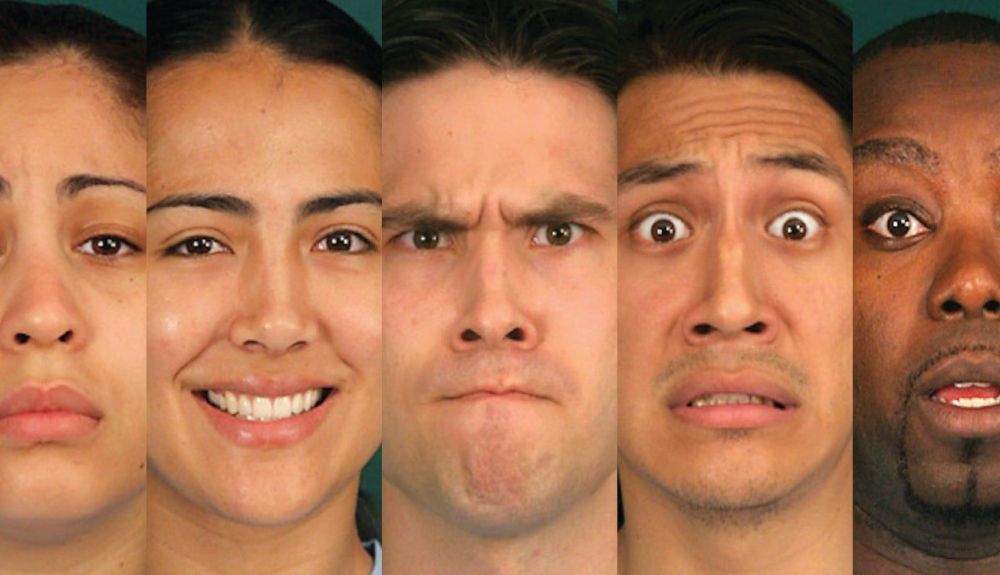

La ciencia subyacente también está en disputa. Muchas aplicaciones de IA de emociones tienen sus orígenes en investigaciones realizadas hace medio siglo por los psicólogos Paul Ekman y Wallace Friesen, quienes teorizaron que un puñado de expresiones faciales corresponden a emociones básicas (ira, disgusto, miedo, felicidad, tristeza y sorpresa; Ekman más tarde agregó desprecio a la lista) y que estas expresiones forman un lenguaje emocional universalmente entendido. Pero estas ideas ahora se debaten acaloradamente.

Los científicos han encontrado evidencia de variaciones culturales e individuales significativas en las expresiones faciales. Muchos investigadores dicen que los algoritmos no pueden, todavía, de todos modos, leer consistentemente las sutilezas de las expresiones humanas en diferentes individuos, que pueden no coincidir con los sentimientos internos estereotipados.

El propio Ekman, que trabajó para desarrollar formas tempranas de tecnología de reconocimiento de emociones, ahora argumenta que representa una seria amenaza para la privacidad y debería estar fuertemente regulada.

Una tecnología no probada

Emotion AI no es intrínsecamente malo. Si las máquinas pueden ser entrenadas para interpretar de manera confiable las emociones y el comportamiento, el potencial para la robótica, la atención médica, los automóviles y otros campos es enorme, dicen los expertos. Pero en este momento el campo es, prácticamente, una tecnología en gran parte no probada podría volverse omnipresente antes de que las sociedades tengan tiempo de considerar los costos potenciales.

En 2018, Mark Gray, entonces vicepresidente de personas y operaciones comerciales de Airtame, que fabrica un dispositivo para presentaciones y pantallas compartidas, estaba buscando formas de mejorar el proceso de contratación de la compañía.

La eficiencia era parte de ello. Airtame es pequeño, con unos 100 empleados repartidos entre oficinas en Copenhague, Nueva York, Los Ángeles y Budapest, pero puede recibir cientos de solicitudes para sus trabajos en marketing o diseño. Otro factor fue la naturaleza caprichosa de las decisiones de contratación.

"En el mundo del reclutamiento y los recursos humanos, que está lleno de lo intangible, quería descubrir cómo puedo agregar un aspecto tangible a la contratación"

"Muchas veces siento que proviene de una voz falsa en la parte posterior de la cabeza de alguien que dice oh, me gusta esta persona personalmente, no esta persona sería más competente", revela Gray, quien ahora está en Proper, una compañía danesa de tecnología de administración de propiedades. "En el mundo del reclutamiento y los recursos humanos, que está lleno de lo intangible, quería descubrir cómo puedo agregar un aspecto tangible a la contratación".

Airtame contrató a Retorio, una compañía con sede en Múnich que utiliza IA en entrevistas en video. El proceso es rápido: los candidatos registran respuestas de 60 segundos a solo dos o tres preguntas. Luego, un algoritmo analiza las expresiones faciales y la voz de los entrevistados y el texto de sus respuestas. A continuación, genera un perfil basado en cinco rasgos básicos de personalidad, un modelo común en psicología abreviado como OCEAN: apertura a la experiencia, conciencia, extraversión, amabilidad y neuroticismo. Los reclutadores reciben una lista clasificada de candidatos en función de qué tan bien se ajusta cada perfil al trabajo.

Dicho software está empezando a cambiar la forma en que se toman las decisiones comerciales y la forma en que las organizaciones interactúan con las personas. Ha remodelado el proceso de contratación en Airtame, elevando instantáneamente a algunos candidatos sobre otros. Gray dice que eso se debe a que el perfil funciona.

Las máquinas que pueden entender las emociones han sido durante mucho tiempo el tema de la ciencia ficción. Pero en ciencias de la computación e ingeniería, el afecto humano siguió siendo un concepto extraño durante mucho tiempo.

La proliferación actual de aplicaciones se remonta a la ampliación del despliegue a partir de principios de la década de 2010 del aprendizaje profundo

Tan recientemente como en la década de 1990, "era un tema tabú, algo indeseable", expone Rosalind Picard, del Instituto de Tecnología de Massachusetts, quien acuñó el término "computación afectiva" en un informe técnico de 1995.

Picard y otros investigadores comenzaron a desarrollar herramientas que podían leer y responder automáticamente a la información biométrica, desde las expresiones faciales hasta el flujo sanguíneo, que indicaba estados emocionales.

Pero la proliferación actual de aplicaciones se remonta a la ampliación del despliegue a partir de principios de la década de 2010 del aprendizaje profundo, una poderosa forma de aprendizaje automático que emplea redes neuronales, que se modelan aproximadamente en cerebros biológicos.

El aprendizaje profundo mejoró el poder y la precisión de los algoritmos de IA para automatizar algunas tareas que, anteriormente, solo las personas podían hacer de manera confiable: conducir, reconocimiento facial y analizar ciertos escaneos médicos.

Cualidades difíciles de definir

Sin embargo, tales sistemas aún están lejos de ser perfectos, y la IA emocional aborda una tarea particularmente formidable. Se supone que los algoritmos reflejan una "verdad fundamental" sobre el mundo: deben identificar una manzana como una manzana, no como un melocotón. El aprendizaje automático consiste en comparar repetidamente datos sin procesar, a menudo de imágenes, pero también de video, audio y otras fuentes, con datos de entrenamiento etiquetados con la característica deseada.

Así es como el sistema aprende a extraer los puntos en común subyacentes, como la "manzana" de las imágenes de manzanas. Una vez finalizado el entrenamiento, un algoritmo puede identificarlas en cualquier imagen.

Cuando la tarea es identificar cualidades difíciles de definir, como la personalidad o la emoción, la verdad se vuelve más difícil de alcanzar

Pero cuando la tarea es identificar cualidades difíciles de definir, como la personalidad o la emoción, la verdad se vuelve más difícil de alcanzar. ¿Cómo es la "felicidad" o el "neuroticismo"? Los algoritmos Emotion-AI no pueden intuir directamente emociones, personalidad o intenciones. En cambio, están entrenados, a través de una especie de crowdsourcing computacional, para imitar los juicios que los humanos hacen sobre otros humanos.

Los críticos dicen que el proceso introduce demasiadas variables subjetivas. "Hay un profundo deslizamiento entre lo que estas cosas nos muestran y lo que podría estar sucediendo en la mente o el espacio emocional de alguien", indica Kate Crawford, de la Escuela de Comunicación y Periodismo Annenberg de la Universidad del Sur de California, que estudia las consecuencias sociales de la inteligencia artificial. "Ese es el salto profundo y peligroso que algunas de estas tecnologías están haciendo".

El proceso que genera esos juicios es complicado, y cada etapa tiene posibles trampas. La IA emocional, requiere enormes conjuntos de datos que combinen miles o a veces miles de millones de juicios humanos: imágenes de personas etiquetadas como "felices" o "sonrientes" por los trabajadores de datos, por ejemplo. Pero los algoritmos pueden "aprender" inadvertidamente los sesgos colectivos y sistemáticos de las personas que reunieron los datos. Ese sesgo puede provenir de datos demográficos sesgados en los conjuntos de entrenamiento, actitudes inconscientes de los etiquetadores u otras fuentes.

Los sistemas de reconocimiento facial, la mayoría también basados en el aprendizaje profundo, han sido ampliamente criticados por su sesgo. Los investigadores del M.I.T. Media Lab, por ejemplo, encontraron que estos sistemas eran menos precisos al coincidir con las identidades de las caras no blancas y no masculinas. Por lo general, estos errores surgen del uso de conjuntos de datos de entrenamiento que sesgan el blanco y el hombre. La identificación de expresiones emocionales agrega capas adicionales de complejidad: estas expresiones son dinámicas y las caras en las fotos posadas pueden tener diferencias sutiles con las de las instantáneas espontáneas.

Muchas empresas ahora enfatizan que son conscientes y abordan tales problemas. El algoritmo de Retorio fue entrenado en un conjunto de datos, compilado durante un período de años utilizando voluntarios pagados, de vídeos cortos de entrevistas etiquetados con rasgos de personalidad, dice el cofundador Christoph Hohenberger.

La compañía ha tomado medidas para filtrar varios sesgos demográficos y culturales que tenderían a favorecer a un grupo sobre otro en las evaluaciones de personalidad

La compañía ha tomado medidas para filtrar varios sesgos demográficos y culturales que tenderían a favorecer a un grupo sobre otro en las evaluaciones de personalidad, dice. Pero debido a que, actualmente, no hay regulación o supervisión de la industria, en la mayoría de los casos tenemos que tomar la palabra de una empresa para ello: la solidez y la equidad de los conjuntos de datos patentados son difíciles de verificar.

HireVue, una compañía que hace entrevistas en vídeo con análisis algorítmico del texto y el tono vocal, contrató a un auditor externo para verificar si había sesgos, pero eso es raro.

"Esta idea de que existe un estándar para que los humanos sean y que todos puedan cumplirlo por igual" es fundamentalmente defectuosa, menciona Ifeoma Ajunwa, profesor asociado de la Facultad de Derecho de la Universidad de Carolina del Norte, que estudia la toma de decisiones de IA. La suposición, dice, significa que "todos los que no cumplen con ese estándar están en desventaja".

La teoría de Ekman y Friesen

Además de las preocupaciones sobre el sesgo, la idea de que las apariencias externas coinciden con una emoción interna descifrable para todos también ha comenzado a generar una fuerte oposición científica. Ese es un cambio desde cuando el concepto comenzó hace más de 50 años.

En ese momento, Ekman y Friesen están realizando un trabajo de campo con fore, un grupo indígena en las tierras altas del sureste de Papúa Nueva Guinea, para ver si reconocían y entendían las expresiones faciales de la misma manera que lo hacían las personas de orígenes radicalmente diferentes: un estibador de Brooklyn, por ejemplo, o una enfermera en Senegal.

Las respuestas de Fore fueron prácticamente idénticas a las de las personas encuestadas en países como Japón o Brasil o Estados Unidos, por lo que los investigadores sostienen que las expresiones faciales son un lenguaje emocional universalmente inteligible

A los voluntarios se les mostraron conjuntos de fotos de personas que hacían expresiones para lo que los científicos llamaron las seis emociones básicas. Para proporcionar contexto, un traductor proporcionó breves descriptores ("Él / ella está mirando algo que huele mal" por disgusto, por ejemplo). Las respuestas de Fore fueron prácticamente idénticas a las de las personas encuestadas en países como Japón o Brasil o Estados Unidos, por lo que los investigadores sostienen que las expresiones faciales son un lenguaje emocional universalmente inteligible.

La noción de un grupo compartido de expresiones que representaban estados emocionales básicos rápidamente se hizo popular en psicología y otros campos. Ekman y Friesen desarrollaron un atlas de miles de movimientos faciales para interpretar estas expresiones, llamado Sistema de Codificación de Acción Facial (FACS). Tanto el atlas como la teoría se convirtieron en piedras angulares de la IA emocional. El trabajo se ha incorporado a muchas aplicaciones de IA, como las desarrolladas por la empresa Affectiva, que incluyen sistemas en el automóvil e investigación de mercado.

Momento a momento, las expresiones faciales reflejan estados internos complicados: una sonrisa puede encubrir el dolor o puede transmitir simpatía

Pero los científicos han argumentado que hay agujeros en las teorías de Ekman. Un estudio de 2012 publicado en Proceedings of the National Academy of Sciences USA, por ejemplo, presentó datos que muestran que las expresiones faciales variaban considerablemente según la cultura. Y en 2019, Lisa Feldman Barrett, psicóloga de la Universidad Northeastern, junto con varios colegas, publicó un estudio que examinó más de 1.000 artículos científicos sobre expresiones faciales. La noción de que las caras revelaban signos externos de emociones comunes se había extendido a campos que iban desde la tecnología hasta la ley, encontraron, pero había poca evidencia sólida de que fuera cierto.

Las emociones básicas son amplias categorías estereotipadas, dice Barrett. Momento a momento, las expresiones faciales reflejan estados internos complicados: una sonrisa puede encubrir el dolor o puede transmitir simpatía. Y hoy, sostiene, es casi imposible que un sistema de IA clasifique de manera consistente y confiable esos estados internos si ha sido entrenado en conjuntos de datos que son esencialmente colecciones de estereotipos etiquetados.

Rueda de emociones

Además del trabajo de Ekman y el modelo de rasgos de personalidad de OCEAN, las empresas de inteligencia artificial emocional han adoptado otros sistemas. Una es una "rueda de emociones” ideada por el fallecido psicólogo Robert Plutchik, que es utilizada por Adoreboard, una compañía con sede en el Reino Unido que analiza la emoción en el texto. Todos estos enfoques ofrecen traducir la complejidad del afecto humano en fórmulas sencillas. También pueden sufrir defectos similares. Un estudio encontró que OCEAN produce resultados inconsistentes en diferentes culturas.

Sin embargo, los investigadores dicen que las aplicaciones de emociones pueden funcionar, si se entienden sus limitaciones. La robotista Ayanna Howard, decana de la Facultad de Ingeniería de la Universidad Estatal de Ohio, utiliza una versión modificada del software de reconocimiento de expresión facial de Microsoft en robots para enseñar comportamiento social a niños con autismo.

Si un robot detecta una expresión "enojada" de su interlocutor, por ejemplo, sus movimientos se adaptarán de manera que calmen la situación. Las expresiones faciales estereotipadas no siempre significan exactamente lo mismo, relata Howard, pero son útiles.

Cualquier cosa que no sea del 100 por ciento de precisión termina discriminando a ciertas personas

En general, los algoritmos que escanean y agregan las reacciones de muchas personas, como los que Zenus usa para leer multitudes, serán más precisos, indica Barrett, porque "mejor que aleatorio" se vuelve estadísticamente significativo con un grupo grande. Pero evaluar a los individuos es más traicionero, porque cualquier cosa que no sea del 100 por ciento de precisión termina discriminando a ciertas personas.

Muchos especialistas en visión artificial ahora están adoptando una visión más agnóstica de las expresiones faciales. (Y más compañías han comenzado a afirmar que no mapean directamente las emociones o los estados internos). "A medida que el campo se ha desarrollado, hay una creciente comprensión de que muchas expresiones no tienen nada que ver con la emoción", expone Jonathan Gratch, profesor de ciencias de la computación en la Universidad del Sur de California, que se especializa en computación afectiva.

Vidas bajo vigilancia

Y a medida que crecen los intentos de mapear y monetizar las expresiones emocionales, los rasgos de personalidad y los comportamientos, están expandiendo las partes de nuestras vidas que pueden caer bajo vigilancia. Después de 20 años de compañías tecnológicas que extraen datos personales del comportamiento on line, un nuevo dominio más íntimo, las caras y los cuerpos y las señales que envían, está preparado para un tratamiento similar.

En diciembre de 2020, VSBLTY anunció una asociación con la cervecera mexicana Grupo Modelo para crear redes de cámaras en sus tiendas para capturar datos para 2027.

"Si desea saber, y alguien está en público, parece que no hay límite en escanearlos en busca de sus emociones"

La demanda existirá dondequiera que haya pantallas y publicidad, dice Hutton. La tecnología "se utilizará en centros de tránsito, o en un aeropuerto, o en un estadio", cuenta. "Los anunciantes están pagando millones de dólares para ser patrocinadores, y sus anuncios aparecen en las pantallas de todo el estadio, y están buscando la validación de ese giro".

Esta tendencia plantea una pregunta legal y social básica: ¿Te pertenecen los datos de tu cara y cuerpo? En la mayoría de los lugares del mundo, la respuesta es no, siempre y cuando su identidad personal se mantenga separada de esos datos. "Si desea saber, y alguien está en público, parece que no hay límite en escanearlos en busca de sus emociones", advierte Jennifer Bard, profesora de la Facultad de Derecho de la Universidad de Cincinnati, que ha estudiado el tema.

La mayoría de las empresas de inteligencia artificial emocional que capturan datos en público dicen que la información es anónima y, por lo tanto, su recopilación no debería provocar preocupación.

La aplicación de su compañía no carga las imágenes faciales reales que capturan sus cámaras, solo los metadatos relevantes sobre el estado de ánimo y la posición

VSBLTY no almacena imágenes faciales u otros datos que puedan vincularse a identidades, dice Hutton. Moutafis, de Zenus, señala que la aplicación de su compañía no carga las imágenes faciales reales que capturan sus cámaras, solo los metadatos relevantes sobre el estado de ánimo y la posición, y que coloca letreros y avisos en las pantallas de las reuniones de que se está produciendo el monitoreo.

"No se necesita el consentimiento explícito", especifica. "Siempre le decimos a la gente es una muy buena práctica; cuando tienes una sensibilidad de vigilancia, tienes que poner una señal de que estas áreas están siendo monitoreadas". Por lo general, aclara Moutafis, a la gente no le importa y se olvida de las cámaras. Pero la diversidad de aplicaciones significa que no hay estándares comunes. Tampoco está nada claro si las personas y los políticos adoptarán esa vigilancia rutinaria una vez que se convierta en un tema político y de políticas.

Ekman, quien anteriormente trabajó con la compañía Emotient y con Apple en emotion AI, ahora advierte que representa una amenaza para la privacidad y dice que las compañías deberían estar legalmente obligadas a obtener el consentimiento de cada persona que escanean. "Desafortunadamente, es una tecnología que se puede usar sin el conocimiento de las personas, y se está utilizando en ellos, y no se está haciendo para hacerlos más felices" argumenta. " Se está utilizando para que compren productos que de otra manera no lo harían. Y ese es probablemente el más benigno de los usos no benévolos de la misma".

Interpretar el contexto

La IA de la emoción también ha entrado en espacios personales, donde el tesoro potencial de datos de comportamiento es aún más rico. Alexa, de Amazon, analiza la entonación vocal de los usuarios en busca de signos de frustración para mejorar sus algoritmos, según un portavoz.

Para 2023, algunos fabricantes de automóviles estrenarán sistemas en cabina habilitados para IA que generarán grandes cantidades de datos sobre el comportamiento del conductor y los pasajeros. Los fabricantes de automóviles querrán que esos datos, también probablemente anonimizados, para fines como refinar las respuestas del sistema y el diseño en el automóvil y para medir el comportamiento agregado, como el rendimiento del conductor.

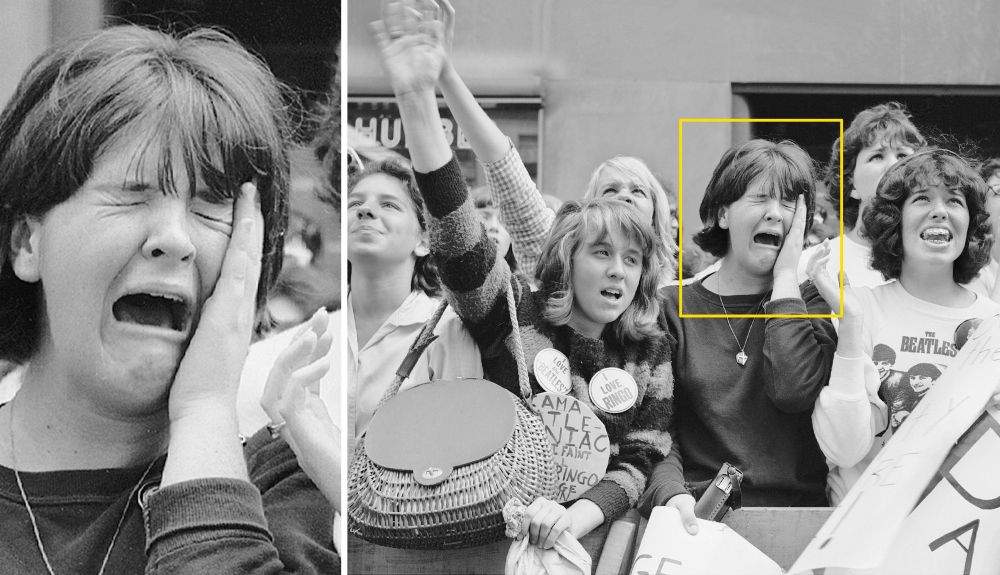

Aleix Martínez, científico de visión por computadora en Ohio State y Amazon y coautor con Barrett del artículo de 2019 que critica la conexión cara-emoción, tiene una foto que le gusta mostrar a la gente. Es de la cara de un hombre que parece estar retorcida en una mezcla de ira y miedo.

Las próximas generaciones de IA emocional pueden combinar exactamente este tipo de información. Pero eso, a su vez, solo creará tecnologías más poderosas e intrusivas para las que las sociedades pueden no estar preparadas

Luego muestra la imagen completa: es un jugador de fútbol exultante después de marcar un gol. Las expresiones faciales, los gestos y otras señales no son solo un producto del cuerpo y el cerebro, señala, sino del contexto, de lo que está sucediendo alrededor de una persona. Hasta ahora, ese ha demostrado ser el mayor desafío para la IA emocional: interpretar el contexto ambiguo. "A menos que sepa lo que es el fútbol, nunca voy a ser capaz de entender lo que pasó allí", dice Martínez. "Así que ese conocimiento es fundamental, y no tenemos ningún sistema de IA en este momento que pueda hacer un buen trabajo en eso en absoluto".

La tecnología se vuelve más efectiva, concreta Martínez, si la tarea es estrecha, el entorno es simple y la información biométrica recopilada es diversa: voz, gestos, pulso, flujo sanguíneo debajo de la piel, etc. Las próximas generaciones de IA emocional pueden combinar exactamente este tipo de información. Pero eso, a su vez, solo creará tecnologías más poderosas e intrusivas para las que las sociedades pueden no estar preparadas.

Fuente. Scientific American.